用上这个工具包,大模型推理性能加速达40倍

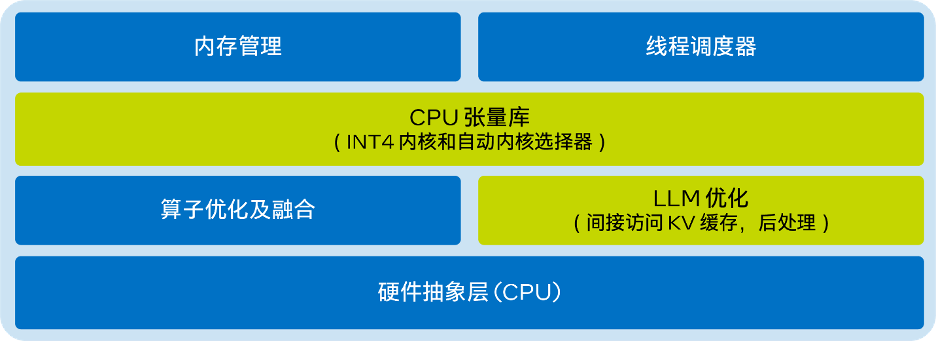

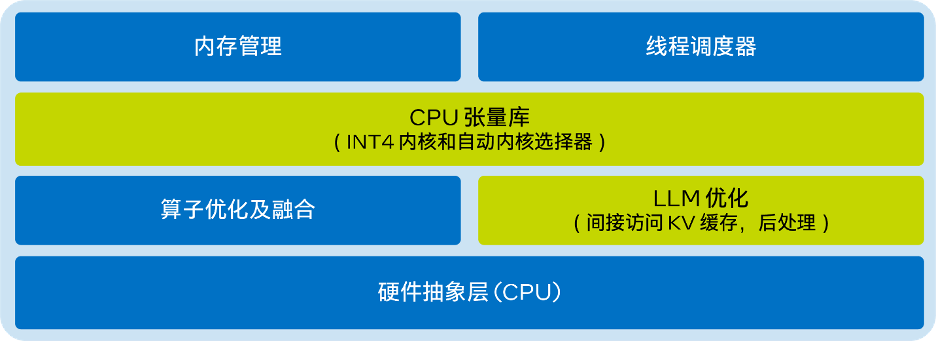

用上这个工具包,大模型推理性能加速达40倍只需不到9行代码,就能在CPU上实现出色的LLM推理性能。英特尔® Extension for Transformer创新工具包中的LLM Runtime为诸多模型显著降低时延,且首个token和下一个token的推理速度分别提升多达40倍和2.68倍,还能满足更多场景应用需求。

来自主题: AI技术研报

4819 点击 2023-11-30 19:10

只需不到9行代码,就能在CPU上实现出色的LLM推理性能。英特尔® Extension for Transformer创新工具包中的LLM Runtime为诸多模型显著降低时延,且首个token和下一个token的推理速度分别提升多达40倍和2.68倍,还能满足更多场景应用需求。

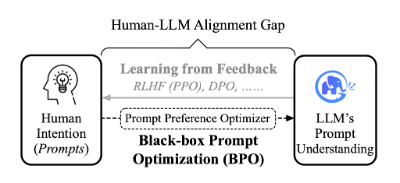

并非所有人都熟知如何与 LLM 进行高效交流。 一种方案是,人向模型对齐。于是有了 「Prompt工程师」这一岗位,专门撰写适配 LLM 的 Prompt,从而让模型能够更好地生成内容。

Agent 的思路为我们带来了 Software 2.0 的图景:LLM 作为推理引擎能力不断增强,AI Agent 框架为其提供结构化思考的方法,软件生产进入“3D 打印”时代

为了解决AutoGPT一旦运行起来就不受控制的痛点,并且调优 LLM Agent 的过程更简单更系统化,波形智能联合苏黎世联邦理工大学和浙江大学,开发了名为 Agents 的开源智能体框架。

本文将对 LLM 的操作方式进行分类,以明确其边界,目标是以一种非专业人士可以理解的方式来解释 LLM 的现状,为Prompt初学的设计者提供简单的理论支撑。